La page Accessibilité sur l'iPhone (Paramètres > Accessibilité) propose des fonctionnalités et des options permettant aux personnes handicapées d'utiliser l'appareil. Les personnes malvoyantes peuvent agrandir le texte de leur iPhone et mieux le définir en utilisant l'impression en gras. Les utilisateurs qui ont des difficultés à entendre peuvent accéder à la page pour coupler des aides auditives conçues pour l'iPhone, ou activer la reconnaissance sonore pour recevoir des notifications lorsque des bruits spécifiques sont entendus par le combiné.

Apple ajoute de nouvelles fonctionnalités pour aider les personnes handicapées

Les malvoyants pourront entendre des descriptions de personnes trouvées sur une image tout en écoutant les données sur un reçu, un tableau ou un graphique. Une photo d'un reçu peut être lue par lignes et colonnes, y compris les en-têtes de tableau. La fonctionnalité expliquera également où une personne est positionnée par rapport aux autres objets de l'image.

La mise à jour ajoutera également la prise en charge sur iPadOS pour les appareils de suivi oculaire tiers permettant aux utilisateurs de contrôler un iPad avec leurs yeux. Quelque temps plus tard cette année, des produits Made for iPhone (MFi) seront disponibles pour suivre où une personne regarde sur un écran iPad. Le mouvement des yeux permettra à un pointeur de naviguer sur l'écran tandis qu'une période prolongée de contact visuel effectuera une action, comme un tapotement.

Apple propose également une fonctionnalité appelée Sons d'arrière-plan qui réduit les distractions et permet à l'utilisateur d'être concentré et calme grâce à certains sons qui seront entendus à travers les haut-parleurs d'un appareil. Les options disponibles comprendront le bruit équilibré, le bruit brillant, les sons sombres, les sons de l'océan, la pluie et le bruit de fond associé à un ruisseau. De nombreuses personnes sont calmées par le bruit de la pluie (surtout lorsqu'il est chaud et sec à l'intérieur).

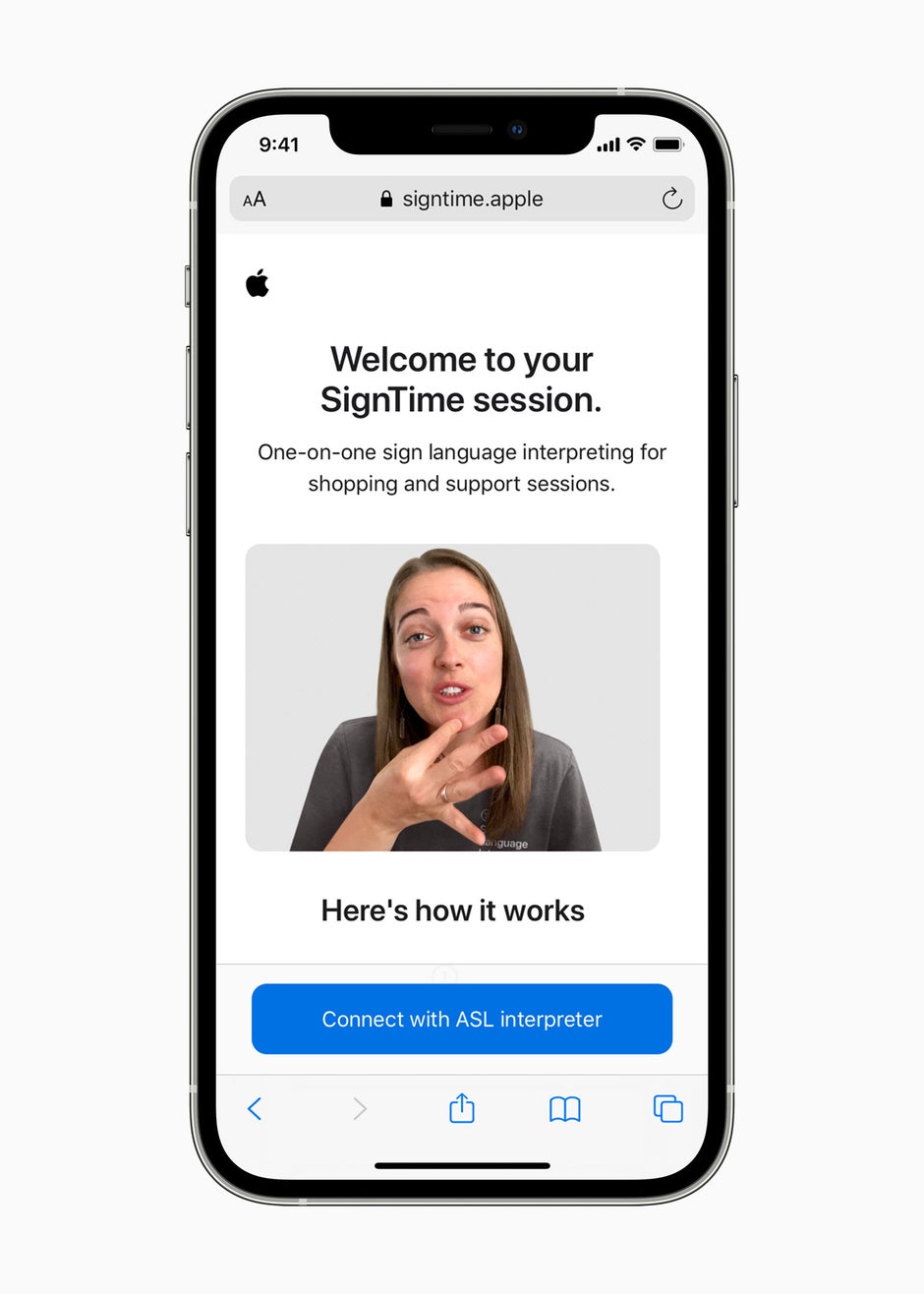

SignTime est lancé aujourd'hui, permet aux malentendants d'utiliser la langue des signes pour communiquer avec AppleCare et plus

Un contrôle d'accessibilité pour ceux qui ont des difficultés à parler sera également à venir plus tard cette année. Avec les actions sonores pour le contrôle des commutateurs, les boutons et commutateurs physiques sont remplacés par des sons générés par la bouche de l'utilisateur, comme un clic, un pop ou un son «ee». Plus tard cette année également, Apple prendra en charge la personnalisation des paramètres d'affichage et de texte pour les applications individuelles et permettra de créer Memoji avec des tubes à oxygène, des implants cochléaires et un casque.

À partir d'aujourd'hui, Apple lance son nouveau programme SignTime qui permet aux clients de communiquer avec AppleCare et le service clientèle de détail via leur navigateur Web en utilisant diverses versions de la langue des signes. Aux États-Unis, la langue des signes américaine (ASL) sera utilisée tandis que ceux du Royaume-Uni signeront avec la langue des signes britannique (BSL). La langue des signes française (LSF) sera utilisée en France. Apple prévoit d'ajouter SignTime à d'autres pays à l'avenir.